随着技术的不断进步,人工智能(AI)已经开始在视频制作领域扮演越来越关键的角色。小鹏汽车的AI研究团队近日推出的“任意物体于任意场景”(Anything in Any Scene)技术引发了业界广泛关注。该技术通过先进的生成式人工智能(AiGC)算法,能够将任意物体无缝集成进动态视频中,创造出极致真实的视觉效果。参与该项研发工作的小鹏汽车AI研究员Xiaoyin Zheng先生深入解读了该技术及其背后的愿景与初衷。

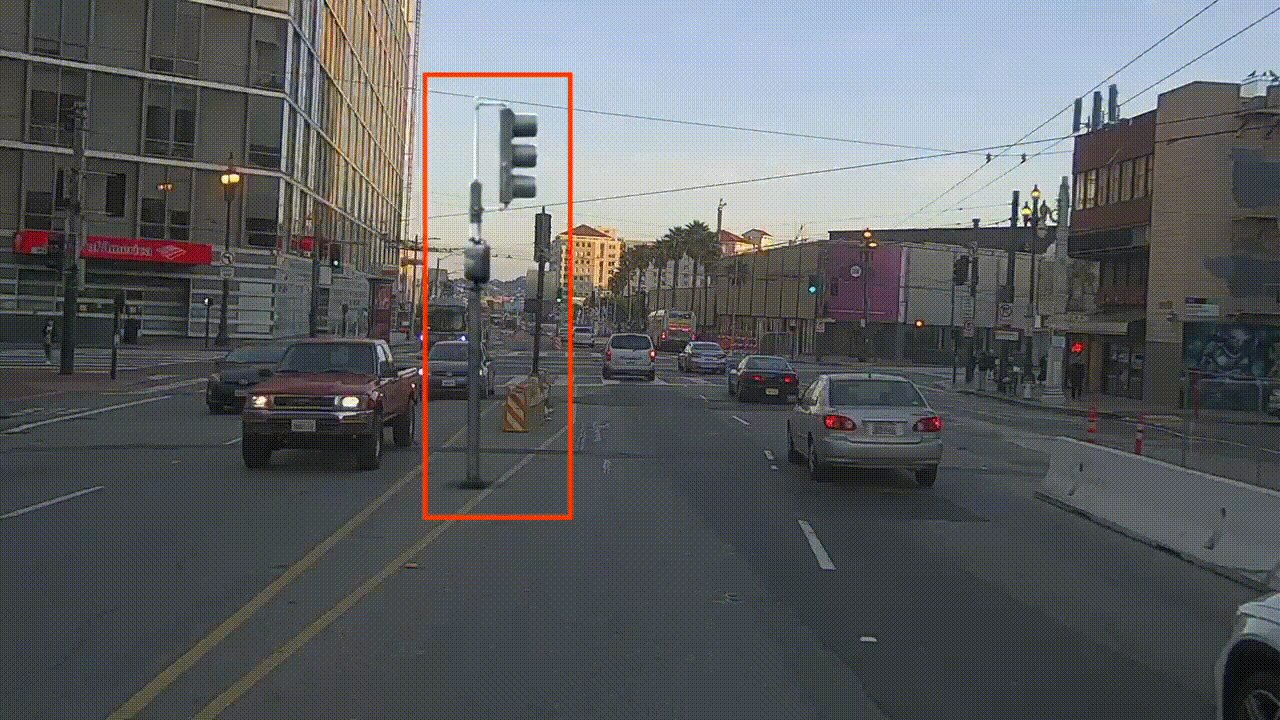

“利用我们研发的Anything in Any Scene技术,用户能在任意的视频场景中,插入任意物品,并且达到以假乱真的程度”。为证实所言非虚,Xiaoyin Zheng展示了应用此技术制作的视频,并邀请记者尝试识别其中后期插入的物体。场景包括室外道路、夜间道路和室内场景。记者经多次观看后,也难以辨识异样,直至Xiaoyin Zheng揭示红绿灯、垃圾桶和头盔等物体竟然均为后期插入。

Xiaoyin Zheng随后介绍了这项技术的架构细节。“相比以往的算法框架,例如DoveNet、PHDiffusion,Anything in Any Scene呈现的效果更加逼真,这得益于我们架构中的三个主要模块,分别保证了物体摆放位置的真实性,光照的真实性,和色调的真实性。在确保物体在视频中正确放置的过程里,我们的技术框架首先确定相机在视频中的世界坐标系位置,将其作为插入物体的基准点。接着,通过分析相机的内参和方位,精确计算出物体三维模型在各个视频帧里的具体位置。我们还使用了语义分割模型预测物体的掩码,避免插入物体被其他物体遮挡。为了使物体在视频中保持稳定,我们会预测视频连续帧之间的光流来跟踪物体的运动轨迹,并减少物体在连续帧上的投影差异,从而实现物体随着摄影角度变化时的平滑移动。为了保证物体光照的真实性,我们还会根据视频流中的天空部分画面,推理出主光源的高光和环境光漫反射这两种光源的HDR分布,并将此HDR分布送给渲染管线中,这样就可以连同物体的阴影一并渲染出来,生成逼真的光照效果。最后,我们会对物体做一个style transfer(风格变换),使其更逼近目标视频流的整体色调,进一步提高整个视频的逼真程度。”

对于外界关于“任意物体于任意场景”技术是否仅用于制作虚假视频的质疑,Xiaoyin Zheng给出了详细的回答。他解释说:“我们开发这项技术的初衷,实际上是为了在数据层面,促进自动驾驶技术的发展。在自动驾驶系统的训练阶段,通常需要收集大量的实际驾驶数据。然而,某些罕见但重要的情形,如道路上的事故车辆、特种车辆、障碍物、行人意外穿越等,往往难以在日常环境中收集到足够的数据样本。若能通过AiGC技术创造出极为逼真的场景数据,就能够以极为低廉的成本,为自动驾驶系统提供持续的、高质量的训练‘养料’。”他进一步阐释,“然而,这项技术的应用远不止于此。正如其名称‘任意物体于任意场景’所暗示的,它赋予了用户在任何视频场景中插入任何物体的能力,这极大地拓展了视频编辑的可能性。无论是在AI视频创作领域,还是在增强现实(AR)与虚拟现实(VR)等新兴领域,这项技术都有着广阔的应用前景。”

在讨论Anything in Any Scene与近期大火的OpenAI SORA之间的关系时,Xiaoyin Zheng认为,这两种技术互相补充而非直接竞争。他指出,在视频创作过程中,SORA和‘任意物体于任意场景’技术都将是重要的工具。“如果我要从头开始利用AI创造一段视频,我会首先用SORA来构建整个场景,接着使用‘任意物体于任意场景’对视频中对物体细节有高精度要求的部分进行细致编辑。通常情况下,SORA负责将视频创作从0到90%,而‘任意物体于任意场景’负责完成剩下的,也是极具难度的10%。有了Anything in Any Scene,使用SORA的创作者可以说是锦上添花,将创作提升到全新的高度。”

展望未来,随着技术的持续发展和完善,Anything in Any Thing与SORA等先进AI工具的结合使用,将不仅为视频创作带来革命性的变革,同时也将在自动驾驶、虚拟现实等多个领域开拓出更广阔的应用空间。这些技术的发展和应用,预示着我们正迈向一个更加智能、更加多元的新时代。人工智能的边界将不断被拓展,创新的火花在不同领域间碰撞,引领我们走向更加精彩的未来。